La pornografía infantil es uno de los flagelos más grandes en el mundo digital. La lucha de los gobiernos para detener el abuso de los niños ha llevado buscar colaboración entre las autoridades de seguridad y las compañías de productos de consumo electrónico. Una de estas colaboraciones se acaba de dar en esto días: Apple anunció que revisara las fotos que se suban a su sistema de almacenamiento en la nube, iCloud, en búsqueda de imágenes de abuso de menores, pero ¿es seguro este sistema? ¿acaso no viola la privacidad?

Desglosemos esta nueva tecnología y tratemos de ver cómo funciona y si es una invasión a la privacidad. Apple anunció una serie de herramientas para mejorar la seguridad en su nube, iCloud. Entre estas nuevas funciones se incluye un sistema de lectura y encriptado, capaz de detectar fotos de niños y si estas fotos contienen material sensible o violento hacia el infante.

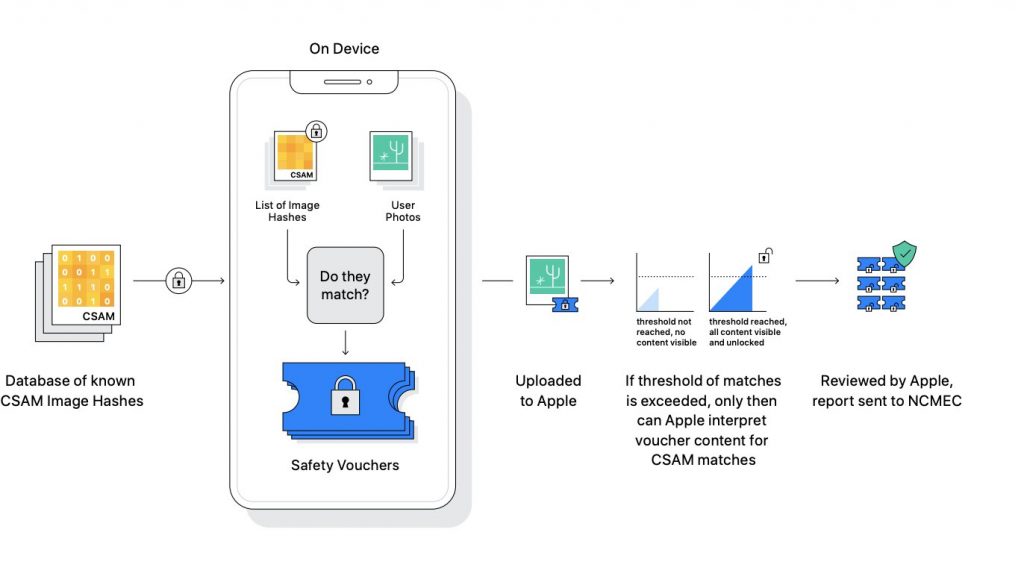

La herramienta posee una escala que le permite determinar el nivel de agresión hacia el niño y en el momento que la imagen sobrepasa ciertos parámetros es enviada a un analista, una persona que determinara si la imagen es ilegal o no. Una vez que el analista determine la naturaleza de la imagen, este podrá, o bien almacenarla de manera segura en la cuenta iCloud del usuario o ser reportada ante las autoridades. También se informaría al Centro Nacional para Niños Desaparecidos y Explotados (NCMEC, por sus siglas en inglés) en Estados Unidos, para determinar si el menor está en su base de datos sobre abuso.

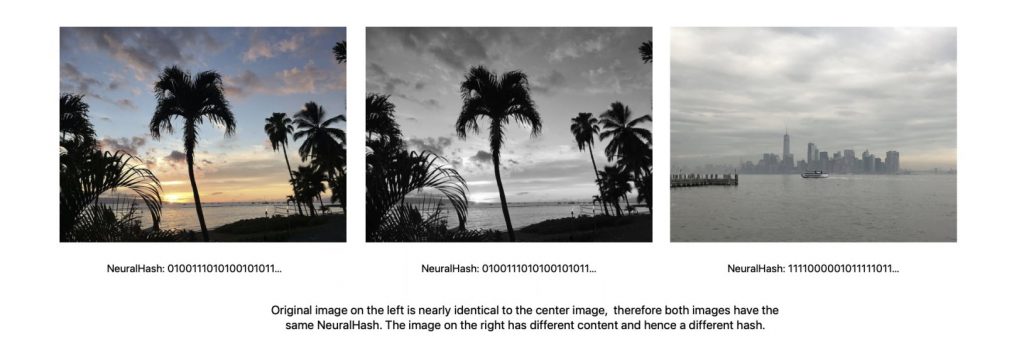

Todo el análisis ocurrirá en los dispositivos; Apple asegura que usa la más avanzada tecnología en encriptación para garantizar los datos del usuario, a menos que esté tratando con imágenes de abuso. En sí, la tecnología no escanea rostros o personas, trasforma las imágenes en una serie de números y cuanto más elevada sea la cifra de estos números, de acuerdo con los parámetros que tienen establecidos en una base de datos como abuso, la imagen es catalogada como potencialmente prueba de abuso infantil. Es aquí cuando una persona, el analista, revisa la imagen.

Destaquemos que una de las cosas que sobresalen de los productos Apple es su seguridad. El sistema de codificación de la marca de la manzana es uno de los más robustos del planeta, al grado que los hackeos son muy complicados y las brechas en él se han dado por errores en el usuario. Esto debería dar un poco de tranquilidad a los usuarios, pero ¿Qué pasa con la seguridad?

Si, Apple revisara cada foto con niños que tomes y se compartan desde tu dispositivo, ya sea un iPhone, iPad o computadora, pero esta revisión la hará un sistema de inteligencia artificial. Tu imagen o foto no será vista por una persona, a menos que rebase el parámetro que determina el abuso.

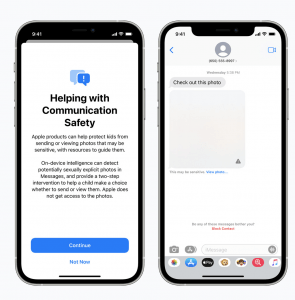

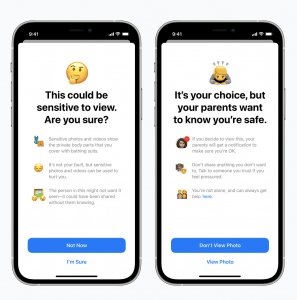

De igual manera los sistemas de mensajería también serán asegurados para evitar abuso a menores. Los padres deberán señalar que una sesión es usada por un menor de 13 años, o bien que su equipo es usado en ese momento por un menor de edad. Así el sistema podrá bloquear imágenes que consideré como peligrosas para el menor y enviar una alerta a los padres para que o bien revisen la imagen o bloqueen al usuario que la envié y lo denuncien ante las autoridades.

Ahora ¿esto no atenta contra la privacidad del usuario? Apple enfatiza que nadie vera o tendrá acceso a tus imágenes. Si tú decides enviar la foto graciosa de un sobrino o hijo a la abuela, la foto solo la verán las personas que envían y reciben. El análisis se hará por la inteligencia artificial (que se incluirá en las nuevas actualizaciones de los sistemas operativos de Apple) por medio de números.

Si bien todo parece seguro y en pos del bienestar de los usuarios, hay expertos en seguridad y encriptación que aun ven problemas de seguridad en esta nueva función de los equipos Apple. La herramienta puede ser usada por algún atacante para agredir a un usuario en particular, bombardeándolo con imágenes que rebasen los parámetros y poniendo en riesgo su integridad e imagen pública. De igual manera puede ser usado por instituciones poco éticas o gobiernos autoritarios para acusar o señalar falsamente a personas.

Aún falta mucho por determinar cuanta injerencia tendría una entidad privada, como Apple, en el señalar un delito o si no se viola algún derecho constitucional o humano al supervisar el contenido que los usuarios comparten. Por el momento queda ver como Apple garantiza la seguridad de este nuevo sistema para que no sea usado de manera errónea y pueda aportar una herramienta contra el tráfico de pornografía infantil.

Por lo pronto pórtense bien, naveguen sano y seguro y respetemos la integridad de los demás.